大家好,我是小潘,《AI超级个体: ChatGPT与AIGC实战指南》作者。

国内的互联网大厂都有一个特点,卷,阿里更是卷王中的卷王。

说阿里卷不是没有道理的,在年初的时候,阿里出了个通义舞王,一下子就火爆了全网!只需要一张图片,你就可以看慈禧扭秧歌。。

甚至可以看到看兵马俑跳科目三。。。

在我第一次看到的时候,我也是震惊了,TM的这竟然是AI做的?太牛了!不愧是卷王阿里。

让慈禧跳扭秧歌已经让我足够震惊了,不到两个月,阿里又出了新招,要被卷麻了。。。

用照片+音频生成会说话唱歌的视频,数字人就可以做到。数字人产品其实很多了,比如heygen、硅基智能等。如果只是和数字人一样的视频,这种程度还不足以让我觉得牛逼。

阿里的EMO和数字人不一样的是,EMO生成的视频表情真的太到位了,足以以假乱真!

在下面的这个视频中,原始照片是由xxmix_9realisticSDXL生成,音频应该是从某部电影里拿到的台词。从生成视频的效果来看,表情真的很到位。

但是,看起来也不是完美无缺,在0:26秒的时,面部似乎有点扭曲的,美女形象一下子就被毁掉了。。。

阿里的EMO,是基于音频驱动的人像视频生成模型,通过输入一个音频,再加上一张照片,就可以生成说话和唱歌的视频了。EMO的亮点在于它生成的视频表情丰富、头部动作自然。

从上面的视频例子可以看出来,表情动作确实很丰富,也比较自然,大部分情况下,表情与当前音频所表达的情绪,都是能够对应上的。

好了,通过上面的一个视频,应该知道阿里的EMO能做什么?牛逼在哪里了吧,接下来,我们再看看阿里的EMO在其他场景的一些表现。

全世界的小伙伴应该都见过下面这位气质满满的少妇,她是openai sora生成的视频中的角色。把她的图像截出来后,加上 Dua Lipa 的Don't Start Now,EMO模型就可以生成这位少妇唱歌的视频了,表情看起来非常自然,不是那种硬邦邦的感觉。

官方提供了好几个唱歌的视频,但我最喜欢的就是下面这个视频了。

下面的这个角色是Stable Diffusion的ChilloutMix模型生成,我似乎在哪里见过,可惜找不到了。

下面的这个视频,表情动作非常丰富,让我感觉似乎真的是一个人在唱歌一样,几乎没有变形的情况。

EMO模型还能够让快节奏的音乐和人物动作表情保持同步,下面的这个视频中,音乐来自于Eminem的Rap God,演示用的角色是大家熟悉的KUN KUN。

看起来都很完美,如果不是从官方得知这个是AI生成的,我还真以为KUN KUN唱过这首歌。但这里有个缺陷,在视频的0:03的时候,视频生成的KUN KUN居然是斗鸡眼!(被KUN KUN的粉丝看到,估计会被打得满头包)。

让照片说话这个能力,1年前可能还是非常惊艳的技术,但是现在已经见怪不怪了,Heygen、D-DI等平台,都提供了工具,能让一张照片“动”起来,开源的还有sadtalk,也可以实现同样的功能。

阿里的EMO让照片的人物形象说话并不是个多么惊艳的技术。它的亮点还是在于人物说话时候的表情!

下面的这个音频来自于国外的一个采访片段,角色形象自然是通过AI生成的了。这个例子没有特别丰富的表情,但看起来整体还是比较流畅,没有违和感的。

而下面的Mona Lisa的表情可就丰富多了

去年的时候,有段时间AI小和尚特别火,下面这个是视频号某个号主的视频,有2400多赞!牛逼吧!这种视频制作成本并不高,midjourney + heygen + eleventlab,直接就可以搞起。

互联网上,很多时候,火过的东西,可能会再次火起来。

原来用heygen制作的数字人,有时动作、表情看起来是有点生硬的。结合EMO,应该可以制作出表情更加丰富,动作更加自然的视频,更加以假乱真的视频。

当然,不只是制作小和尚的视频,还可以很多类似的视频,比如去年火起来的外国小姐姐讲人生道理等等。如果EMO的实际效果真的如DEMO视频中一样好的话,那么想象空间是巨大的。

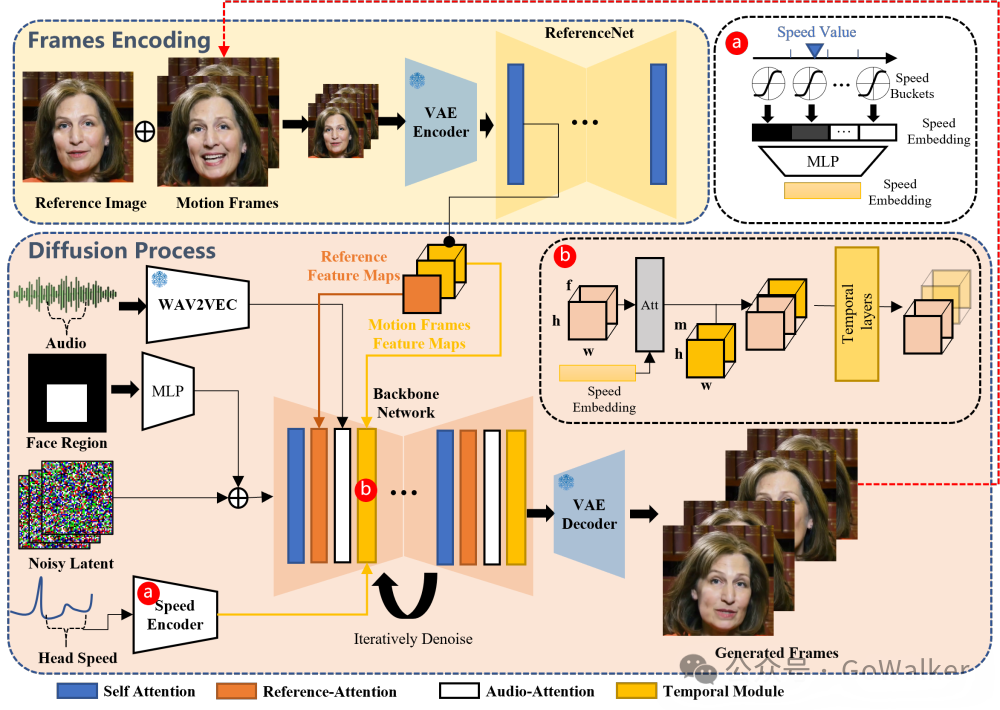

好了,本次分享就到这里了,本来想着再分享下EMO的原理,不过,发现整体解析起来还真有点复杂,所以就不在这里分享了,最后,附上一张原理图